- HOME

- 研究・社会連携

- 産官学連携

- 研究探訪(研究者紹介)〜サギタリウスからのメッセージ〜

- コンピュータ理工学部 ネットワークメディア学科 教授 蚊野 浩

コンピュータ理工学部 ネットワークメディア学科 教授 蚊野 浩

カメラとコンピュータを融合 画像処理技術で未来を拓く!

デジカメで撮影したたった1枚の画像も、コンピュータによる処理によって、さまざまな機器で使え、いろいろな用途に活用可能なデータに変身します。私の研究室では、進歩著しい「コンピュータビジョン技術」の研究を進めています。

コンピュータビジョン技術で デジカメ画像処理のさらなる進化を

今、世界人口70億人に対して、世界中で年間10億台以上のカメラが作られています。デジカメだけに限っても1.2億台。いわゆる写真撮影専用機としてのカメラだけでなく、携帯電話にもカメラ機能が組み込まれており、工場の製造現場やセキュリティ、医療、個人生活など社会のあらゆるシーンでカメラによる画像が活用されています。もはやカメラによる画像なくして立ちゆかない時代になっているといってもいいでしょう。

写真が発明されたのは1825年。銀塩フィルム写真技術が確立されたのは19世紀末です。1981年、処理はアナログながら電気で記録する電子スチルカメラ、ソニーの「マビカ」が開発され、1988年には富士フイルムから世界初のデジタルカメラ「FUJIX DS-1P」が登場、1995年のカシオ「QV-10」で一気に普及し始めます。一般にこの年を「デジカメ元年」と呼んでいます。

デジタル家電は世界最大の産業の一つであり、そのうちデジタルカメラは日本が優位に立つ唯一のデジタル家電。現在もさまざまな形で新たなデジタルカメラ技術が生まれています。

私たちが研究しているのは、そんなカメラ(デジタルカメラ)による画像とコンピュータを融合させる技術。いわゆる「コンピュータビジョン技術」です。コンピュータビジョンとは、画像を取り込む機械装置から情報を認識するための人工知能的理論まで、コンピュータがこの世界の情報を画像として取り込み利用するための全てを対象にした幅広い学問分野のことです。

私たちの目標はコンピュータビジョン技術を使ってコンピュータで人間の知的作業をさせること。例えば、人間がどのようにして画像を認識・理解しているのかを分析、同じことをコンピュータにさせる技術に科学的な関心があります。

そして、それを世に役立つ技術に仕上げることです。例えば、デジタルカメラの画像処理技術(私は「デジカメ画像処理」と呼んでいます)。第1に画像のノイズ除去や色信号の補正など従来からある写真画像処理。第2に、オートフォーカスや移動被写体の追跡などカメラを使いやすくする制御技術。第3はレンズや撮像素子など撮像系の工夫と高度な画像処理の融合によるコンピュテーショナル・フォトグラフィ技術(画像処理がレンズ・撮像素子の再設計を促し、既成概念を超えたカメラ技術)です。

ベースは複数画像情報の統合技術 パノラマ画像合成技術や 全周囲モニタシステムを開発

私がデジタル画像技術に関わり始めたのは、1984年に電機メーカーに就職、カラー記録装置の開発を担当してからです。当時、濃淡画像やカラー画像を出力する技術の開発が盛んになってきていました。

私の専門は本来はコンピュータ技術ですが、自然とカメラに関心を持つようになりました。画像情報はカメラ的な装置で入力してそれをコンピュータで中間処理、最後はプリンタ的な装置で出力します。画像を扱うシステムではカメラとコンピュータ技術を密接に結びつけることが自然だからです。

こうした研究活動を通じて、デジタル画像の新技術開発に貢献しようと決意。主に位置的情報や幾何学的情報を手がかりにして、複数画像の情報を統合する技術に取り組みました。

1993〜1995年には、米国カーネギーメロン大学の金出武雄教授の指導のもとで「ビデオレートステレオマシン」を開発。マルチカメラヘッドを使い、被写体までの距離情報を表現する画像を毎秒30枚出力できるマシンです。

その後、ハンドヘルド型3Dスキャナー、手持ちカメラによるパノラマ画像合成技術、複数の車積カメラを用いた全周囲モニタシステムなどを開発しました。

全周囲モニタシステムとは、車に前後左右4台のカメラを設置、鳥瞰画像(上空から真下をみたような画像)をソフトウェア的に作り出す技術です。運転手が4台のカメラからの映像を個別に見て障害物などを確認するのは至難の技ですが、4台のカメラの画像を道路面を共通の観察領域として合成処理した1つの画像(あたかもトラックを上空から見たような鳥瞰画像)なら、周囲の状況を一目で確認できます。パノラマ画像合成技術活用の一例です。

2000年代からはデジタルカメラの世界でコンピュータビジョンによる画像処理が盛んになり、顔認識や手ぶれ補正、フォーカスロック(被写体を追跡して焦点を合わせ続ける技術)の開発を担いました。

撮影後にフォーカス変更可能 ライトフィールドカメラの改良に挑戦中

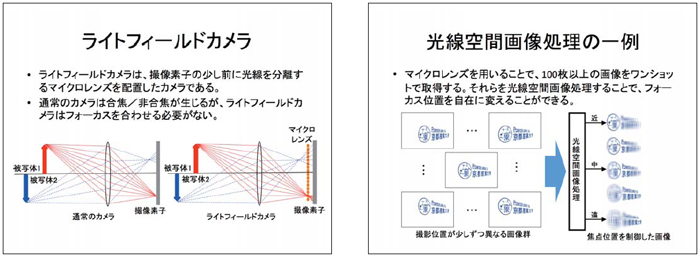

現在、力を入れているのは、普通の写真技術から少し離れたもの。例えば、「ライトフィールドカメラ」です。直訳すると「光線空間カメラ」。色と輝度に加え光線の方向も同時に記録、撮影した後で画面のどこにでもピントを合わせ直しでき、3D写真としても出力可能なカメラです。シリコンバレーの新興企業Lytro(http://www.lytro.com)が2011年に発表、2012年初頭から米国限定で出荷開始予定です。

撮影時に記録したさまざまな方向からの光をソフトウェア的に処理して、任意の部分にピントが合った画像や3D画像を作り出す仕組みです。ハードウェア的には、対物レンズのほかに、画像センサーの1mmほど前に、画素数÷同時撮影カット数の微小レンズを並べ、1回の撮影で100カットほどを同時撮影できるようになっています。

この技術はピンぼけミスの防止や防犯カメラとしての利用、撮影位置を変えた写真の合成など、実に幅広い分野への応用が考えられます。

現在、私たちの研究室ではライトフィールドカメラを模したシステム(15×15の225画像同時撮影)を組み上げ、画素数を上げる、ズーム、絞りなど普通のデジタルカメラに装備されている機能を組み込むなどの基本性能を上げる研究を続けています。また、このシステムを使って物理的なレンズでは不可能な「この世に存在しないレンズワーク」をソフトウェア的に実現する技術も視野に入れています。

将来は画像以外の分野まで対象を広げて、これまで人間しかできないと思われていた作業をコンピュータにやらせる技術を開発していきたいと考えています。